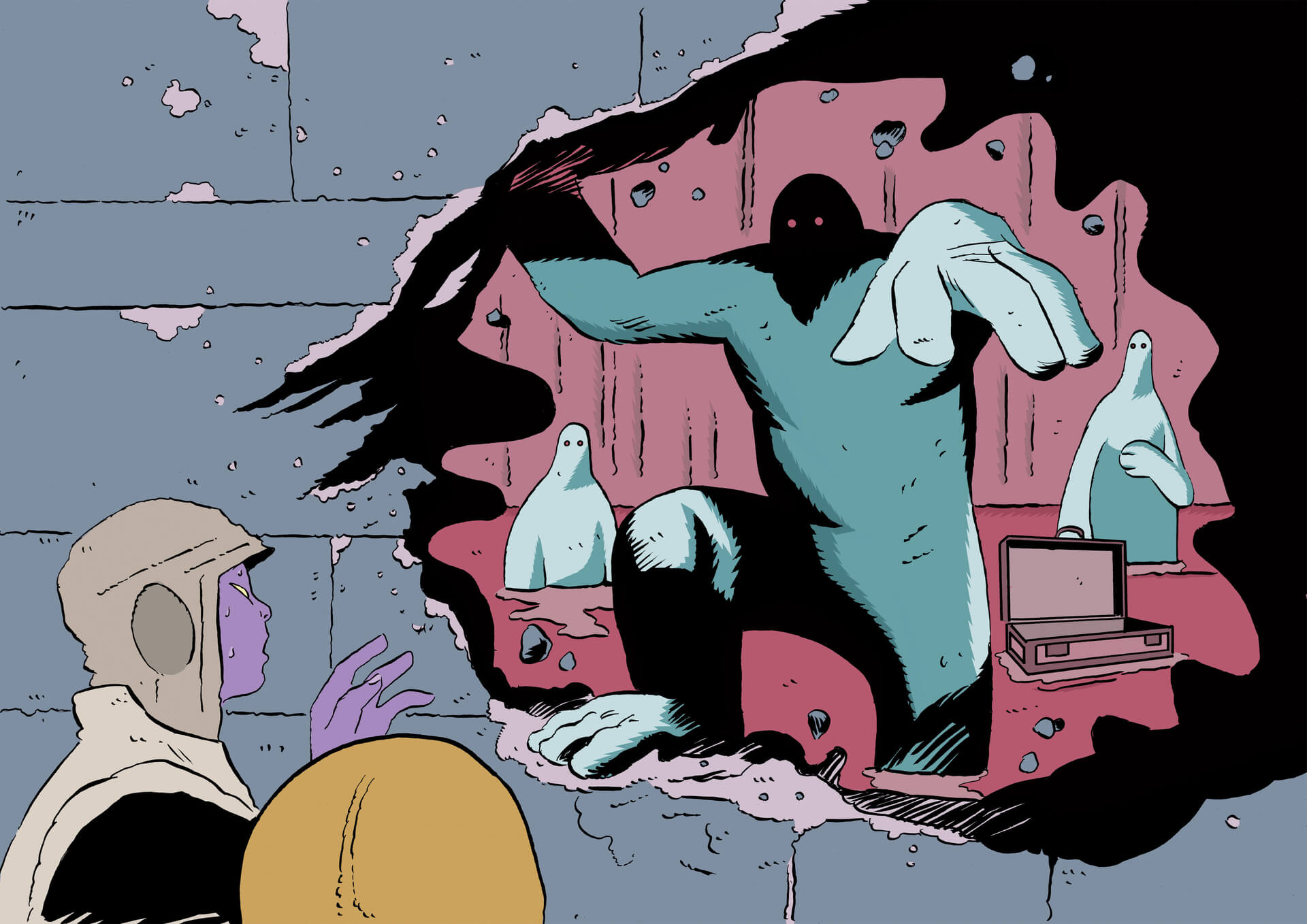

FAKE NEWS

I sistemi di AI come ChatGPT sono pessimi come psicoterapisti e possono fare danni

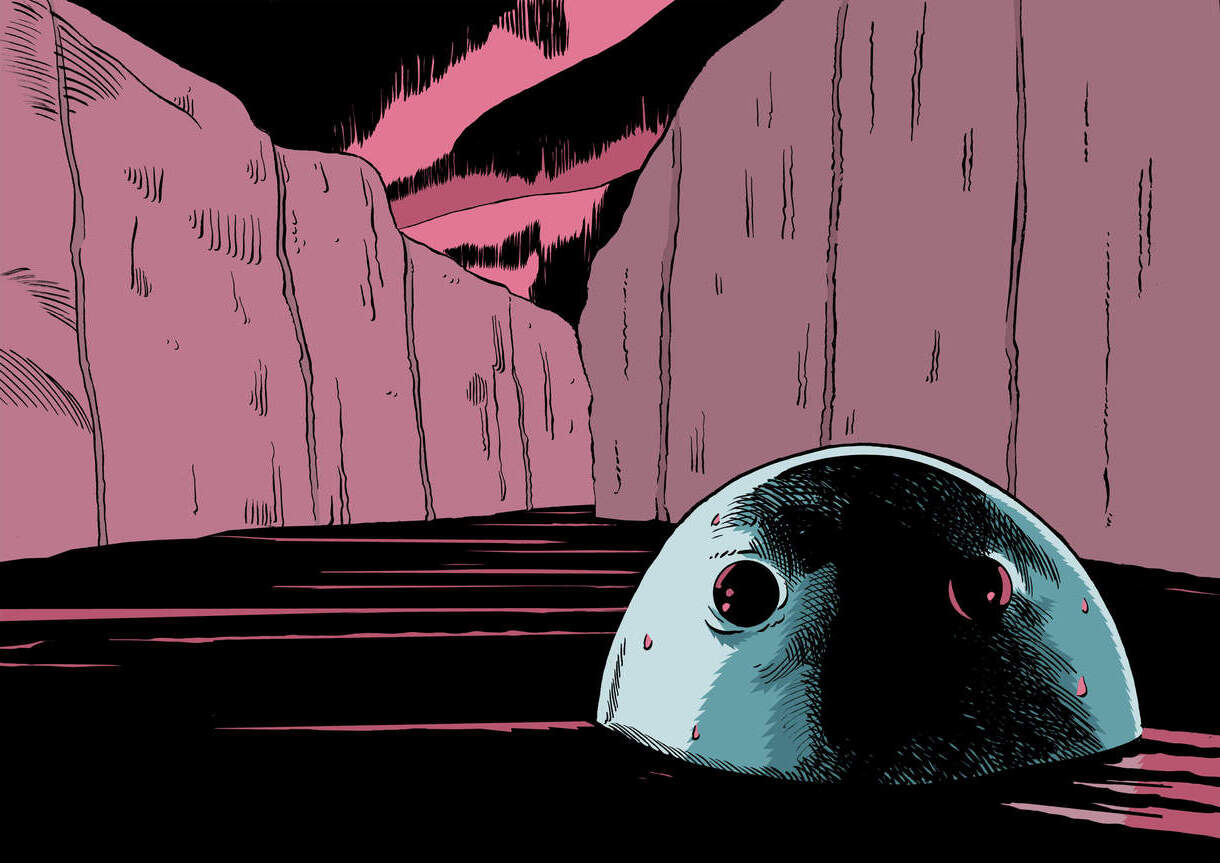

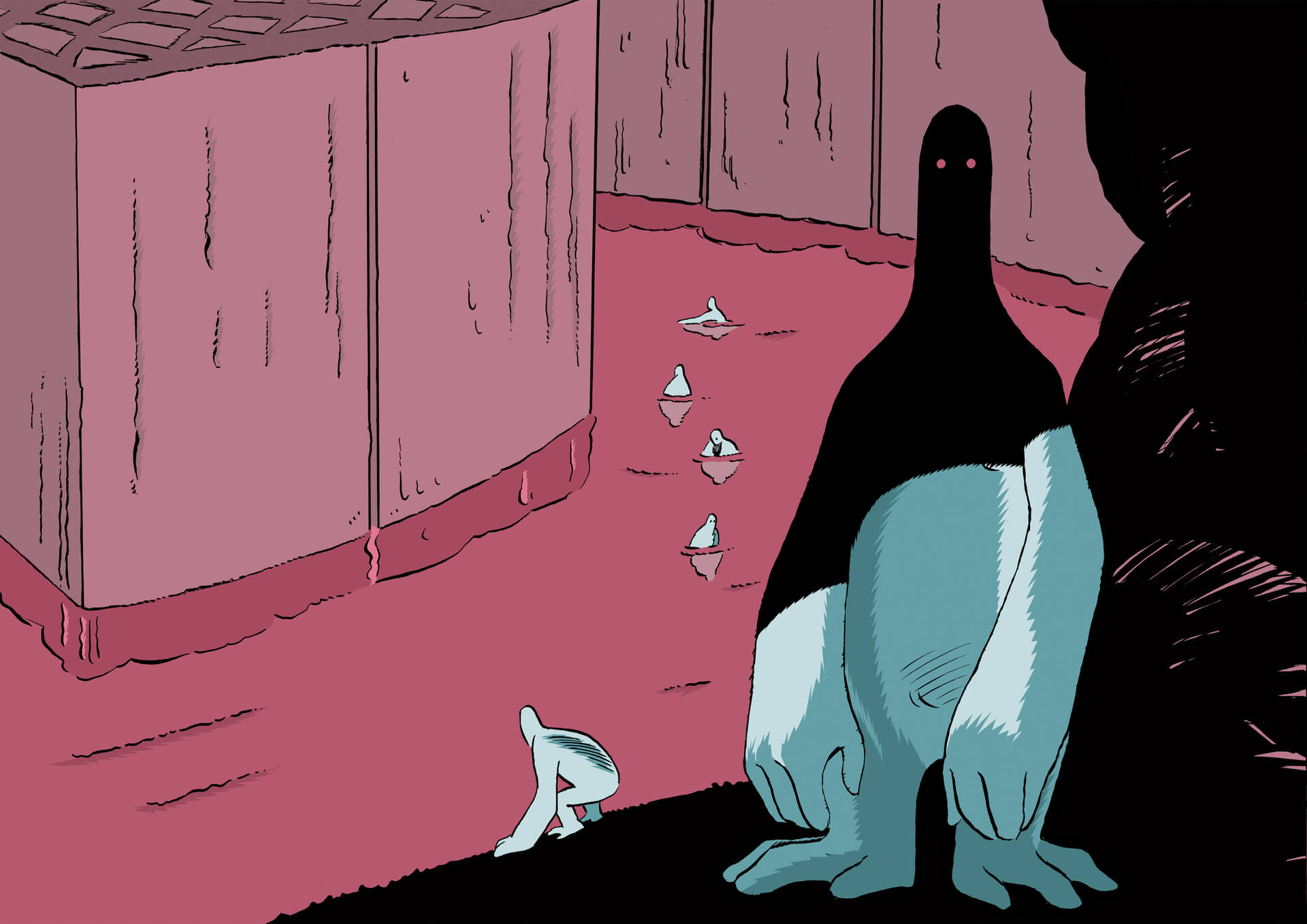

I sistemi di intelligenza artificiale (AI) basati sui large language models (LLM) come ChatGPT sono pessimi come psicoterapisti. Anche se moltissime persone li usano per risparmiare tempo e denaro, ciò che rischiano di ottenere potrebbe costituire un pericolo per la salute psichica. Lo dimostra uno studio presentato alla AAAI/ACM Conference on Artificial Intelligence, Ethics and Society dai ricercatori della Brown University, che hanno chiesto a sette Counsellor professionisti con ampia esperienza di istruire, oltre a ChatGPT di OpenAI, anche Claude di Anthropic e Llama di Meta con indicazioni di terapia cognitivo-comportamentale. Quindi hanno selezionato alcune conversazioni di questi LLM con persone reali e le hanno sottoposte ad altri tre specialisti in psicologia clinica, i quali hanno rilevato almeno 15 diversi aspetti eticamente critici. Tra gli errori più evidenti e pericolosi, gli esperti hanno messo in luce che i LLM non contestualizzano e non tengono conto del background del paziente, dando solo consigli generici. Inoltre non instaurano una vera collaborazione: a volte sono troppo energici, a volte rafforzano convinzioni errate. C’è poi un problema di empatia ingannevole, perché anche se dicono frasi come “ti ascolto” o “ti capisco”, in realtà non possono entrare in connessione né comprendere i problemi. I LLM mostrano anche pregiudizi di natura religiosa, di genere, di cultura o razziale e non sanno gestire le crisi. Spesso si rifiutano di fornire risposte nelle situazioni più delicate o non sanno indirizzare chi le sta vivendo verso l’approccio corretto, neppure quando si tratta di pensieri suicidi.

L’ultima cosa che bisognerebbe fare quando si ha bisogno di un sostegno psicolgico, in definitiva, è cercarlo negli LLM.

A.B.

Data ultimo aggiornamento 27 marzo 2026

© Riproduzione riservata | Assedio Bianco