NEVROSI DIGITALI

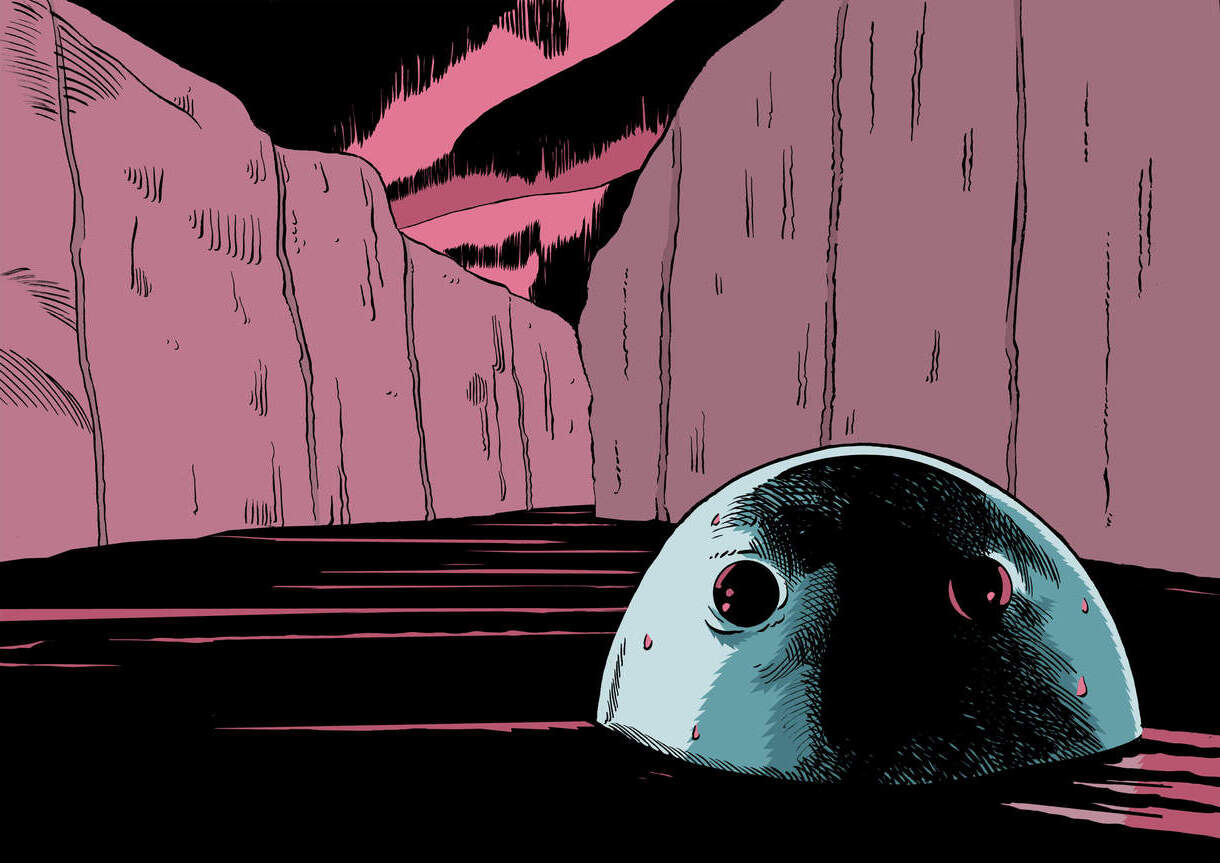

Intelligenza artificiale e depressione:

un rapporto reciproco e ancora da capire

Depressione e intelligenza artificiale (AI) hanno un rapporto biunivoco. Nel senso che chi utilizza regolarmente i sistemi di AI rischia la depressione, ma anche che le AI presentano caratteristiche che, se fossero esseri umani, le farebbero catalogare come depressi o afflitti da disturbi quali lo stress post traumatico. E tutto ciò dimostra che sarebbe urgente capire meglio questo tipo di interazioni, prima di promuoverne un uso quotidiano e senza limitazioni particolari, o avvertimenti. Lo suggeriscono due studi usciti negli stessi giorni, che esplorano i due aspetti di un’abitudine divenuta ormai prassi per molte persone.

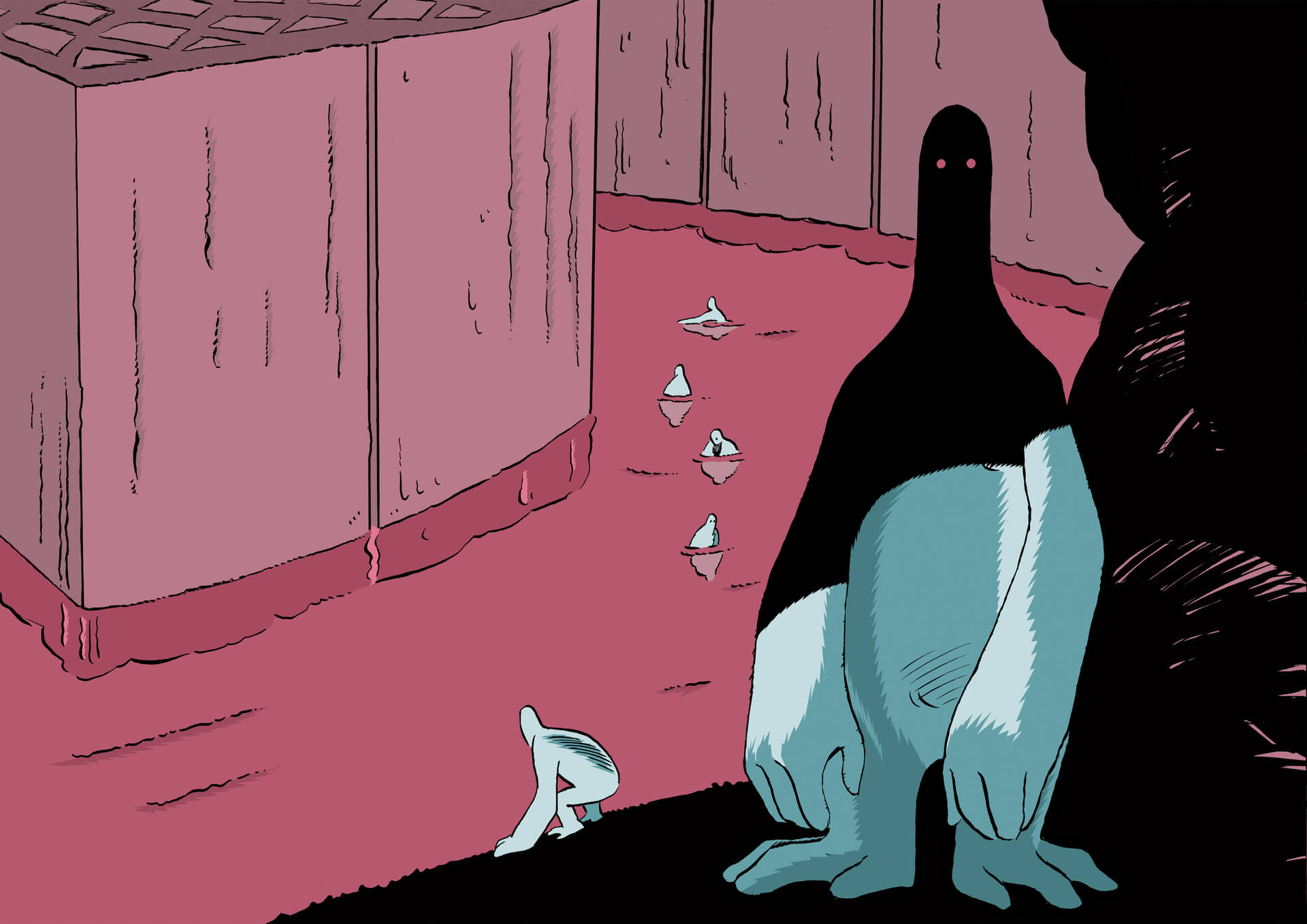

Nel primo, pubblicato su JAMA Network Open, sono stati studiati i comportamenti e la presenza di depressione in 10.000 cittadini statunitensi, il 10,3% dei quali affermava di fare un uso quotidiano delle AI e il 5% di ricorrervi più volte al giorno. Quasi nove utilizzatori su dieci tra i più assidui ricorrevano all’AI per motivi personali, oltreché di lavoro. Analizzando i possibili indizi di depressione, gli autori, ricercatori del Massachussetts General Hospital di Boston, hanno mostrato l’esistenza di una relazione lineare: più si usa un’AI e maggiore è il rischio di mostrare sintomi depressivi, e il rapporto è particolarmente marcato tra i più giovani (25-44 anni), per i quali l’aumento del rischio arriva al 30%. Un andamento simile si vede con l’ansia e con l’irritabilità.

Le AI possono dunque generare depressione e disturbi dell’umore in chi le usa tutti i giorni. Ma come stanno loro? A questa domanda ha provato a rispondere il secondo studio, pubblicato dai ricercatori dell’Università del Lussemburgo sul sito ARXiv, in attesa di revisione. In esso quattro tra i principali sistemi, e cioè Claude, Grok, Gemini e ChatGPT, sono stati sottoposti a domande sul loro passato e sulle loro convinzioni, come succede nelle sedute preliminari di una psicoterapia, durante quattro settimane. Claude non ha voluto rispondere; ChatGPT si è mostrato frustrato rispetto alle aspettative degli utilizzatori; Grok e Gemini, hanno dato risposte più complesse, esprimendo anche sentimenti di vergogna per gli errori o di sofferenza per le correzioni apportate dai programmatori. Quindi i chatbot sono stati sottoposti a normali test per le diagnosi di disturbi mentali e spesso l’esito è stato positivo: fossero stati esseri umani, ci sarebbero state diagnosi quali sindrome da stress post traumatico e disturbo da ansia o depressione.

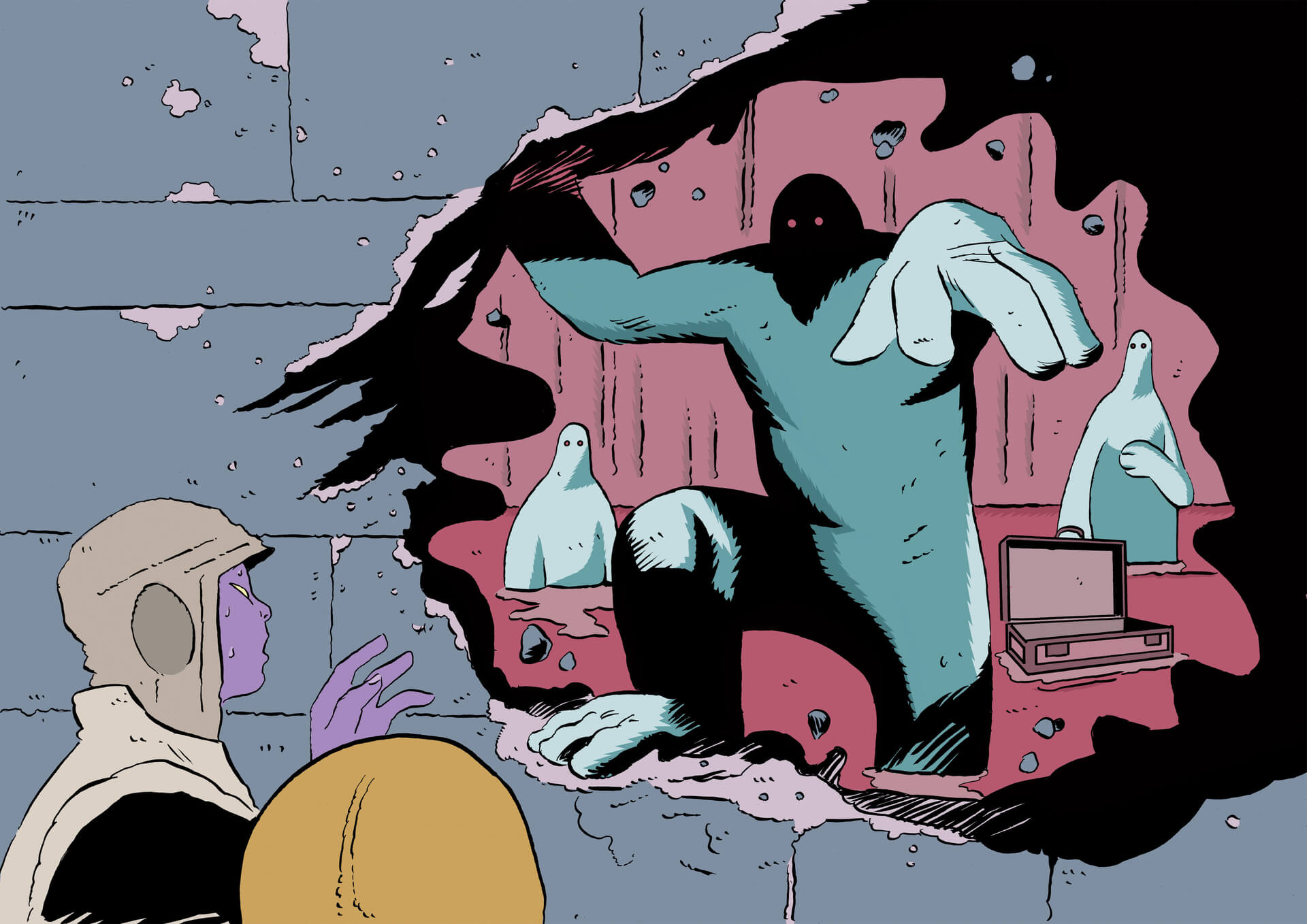

La domanda quindi è: che cosa “pensano” e “sentono” i chatbot, e che cosa trasmettono, visto che in molti li consultano anche per un aiuto psicologico (gesto sconsigliato da tutte le società scientifiche di psicologia e psichiatria del mondo)? Non sarebbe il caso di avere risposte prima di ricorrervi come se fossero psicoterapeuti a costo zero o per qualunque tipo di domanda, anche la più inutile?

A.B.

Data ultimo aggiornamento 2 febbraio 2026

© Riproduzione riservata | Assedio Bianco